人が頭の中で考えている情景をテキストで記述する近未来的な技術が、NTTの考案による「マインド・キャプショニング」。

自然な文脈のテキストまで出力可能に

これは脳の血流変化を計測するfMRIで取得した脳活動信号を用い、脳活動から心身の状態を解読する脳情報デコーディングに、言語AIモデルを統合して実現。人が見ているものだけでなく、頭の中で思い浮かべている情景に関する視覚内容を予測し、文章化する実証に成功したのは世界初だ。

これまでも「犬」や「人」といった単語レベルの予測はできたが、新技術では文章レベルの意味を扱えるAIを活用することで、自然な文脈のテキストとしての出力が可能に。実証実験では2000本超の動画を用意し、参加者6名が1人あたり延べ17時間に及ぶ脳活動計測を実施。開発にあたったNTT CS研の堀川友慈特別研究員によれば、100本の候補動画の中から、見ている動画を当てる精度は平均で約50%に達したという。

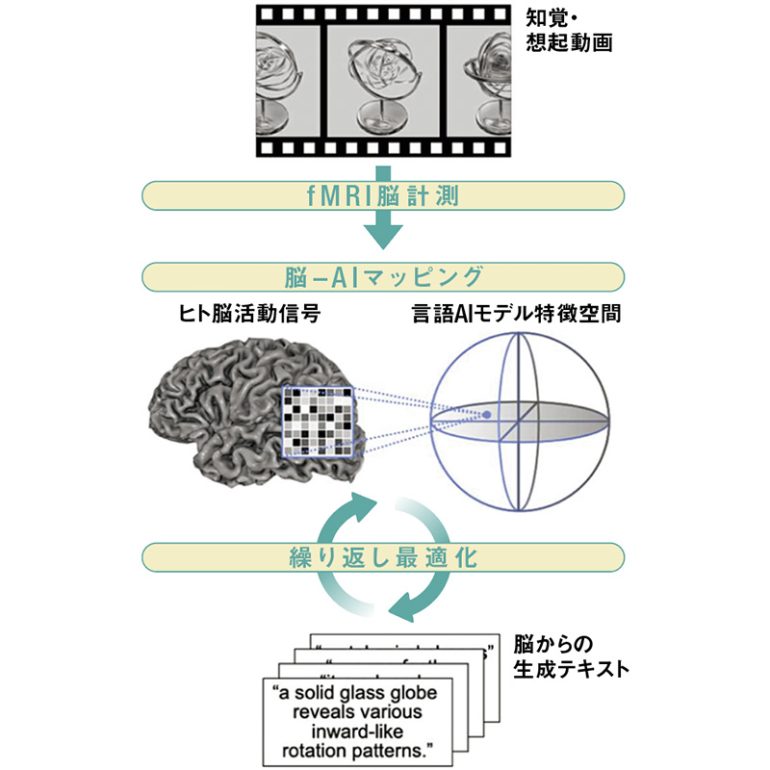

脳内情報がテキスト化されるまで

動画を見ている時のfMRI脳活動信号を言語AIモデルにマッピング。脳活動が表わす情報に近づくようテキストを繰り返し最適化することで、文章を生成する仕組み。

「脳で意思疎通が図れるため、失語症の方のコミュニケーション支援、言葉を話せない乳幼児や動物などの脳の思考発達過程の研究にも応用できる可能性があります」(堀川さん)。

未来への扉がまたひとつ開かれようとしている。

取材・文/安藤政弘 編集/原口りう子

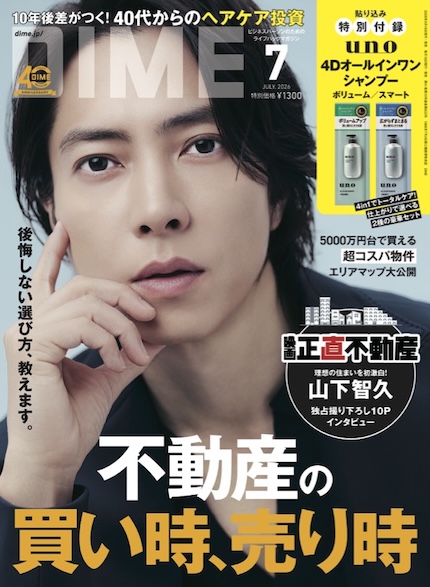

DIME MAGAZINE

DIME MAGAZINE