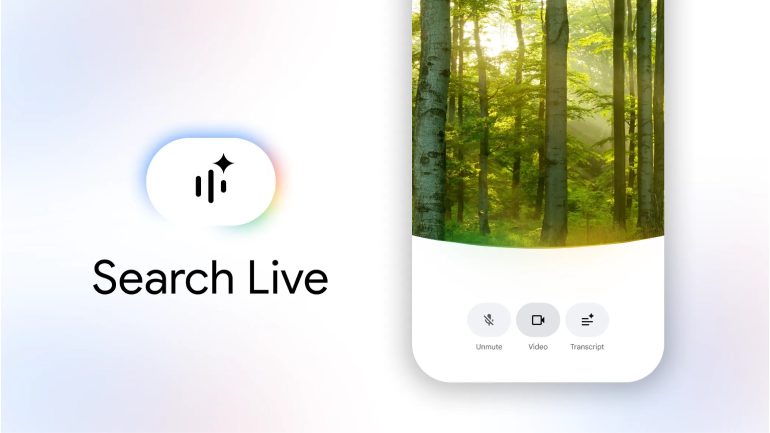

Google検索のAIモードとインタラクティブな会話が可能に

Googleは2026年3月27日(日本時間)より、Google検索のAIモードが利用可能なすべての言語と地域において、検索Liveの利用提供を開始した。

今回のサービスローンチにより、世界の200以上の国と地域で、Google検索のAIモードと音声&カメラを使ったインタラクティブな会話ができるようになる。

この機能拡張は、より自然で直感的な会話を可能にする新しい音声モデルGemini 3.1 Flash Live によって実現した。新しいモデルは標準で多言語対応しており、世界中の人々が自身の使い慣れた言語でGoogle検索と会話できる。

■リアルタイムで質問に回答、深く掘り下げるためのリンクも表示

検索Liveは、Google検索がカメラに映っているものを認識。リアルタイムで質問に答えるとともに、さらに深く掘り下げるためのウェブリンクを表示する機能である。

リアルタイムの助けが必要な場面や、クエリを入力するだけでは不十分な時のために設計されている。

検索Liveを開始するには、Googleアプリ(AndroidまたはiOS 版)にて、検索バーの下にある「ライブ」アイコンをタップするだけ。質問を声に出すと、役立つ音声回答が得られる。さらに、そのまま追加の質問をして会話を続けたり、関連するウェブリンクで詳細を確認したりすることも可能だ。

■カメラを有効にして視覚的な情報を追加できる

目の前にあるものについて質問したい時、例えば観葉植物の葉が黄色くなった原因を知りたいといった場面でも、カメラを有効にして視覚的な情報を追加することができる。

これにより、検索はカメラに映っている状況を認識。役立つヒントと併せて、ウェブ上のより詳しい情報へのリンクを提案する。

< 関連デモ画面はこちらからチェック>

Google レンズでカメラをかざした状態からでも、 検索 Liveの利用が可能だ。画面下部の「ライブ」オプションをタップするだけで、目の前にあるものについて、リアルタイムで会話ができる。

また、「文字起こし」ボタンをタップしてテキスト形式の回答を確認したり、文字を入力して質問を続けることも可能だ。

関連情報

https://blog.google/intl/ja-jp/products/explore-get-answers/search-live-global-expansion/

構成/清水眞希

DIME MAGAZINE

DIME MAGAZINE