生成AIによるコンテンツ生成などAIに関するさまざまな問題点が注目されているが、消費者向けサイバーセキュリティブランド『ノートン(Gen)』は、日本を含む12か国(オーストラリア、ブラジル、チェコ共和国、フランス、ドイツ、香港、イタリア、日本、メキシコ、ニュージーランド、イギリス、アメリカ)の消費者を対象に実施した「マッチングアプリに関する実態調査」を実施し、マッチングアプリ上でのAIの活用状況に関するデータを中心とした調査結果を公表した。

スタジオジブリ風の画像生成に意図しない情報流出リスクも

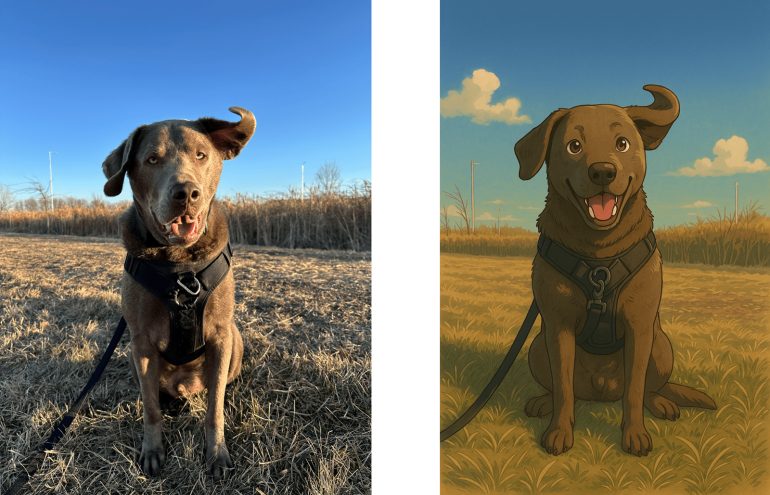

AI技術の進化でスタジオジブリ風の画像生成できるツールがトレンドとして世界中で人気を集める状況もあるが、生成画像を通じて本人も気づかないうちに個人情報が流出するなど新たなセキュリティリスクが顕在化しているという。ノートンのセキュリティ専門家は、「AIツールは利便性や創造性をもたらす一方で、プライバシー保護の観点から十分な注意が必要です。特に生成された画像に学校名やロゴ、地名などの個人を特定し得る情報が含まれていた場合、意図しない情報流出につながる可能性がある」と指摘している。

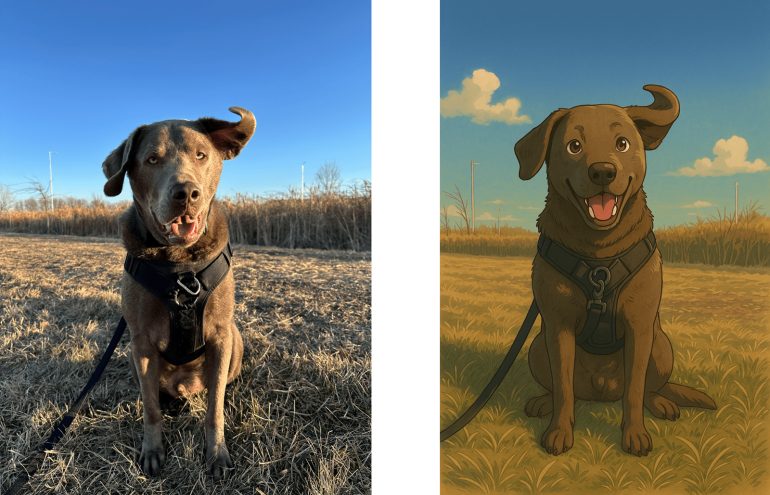

実際の写真(左)とAIで生成したジブリ風の画像(右)こういったAI生成画像もセキュリティリスクにつながるという。

実際の写真(左)とAIで生成したジブリ風の画像(右)こういったAI生成画像もセキュリティリスクにつながるという。

進むマッチングアプリでのAI活用

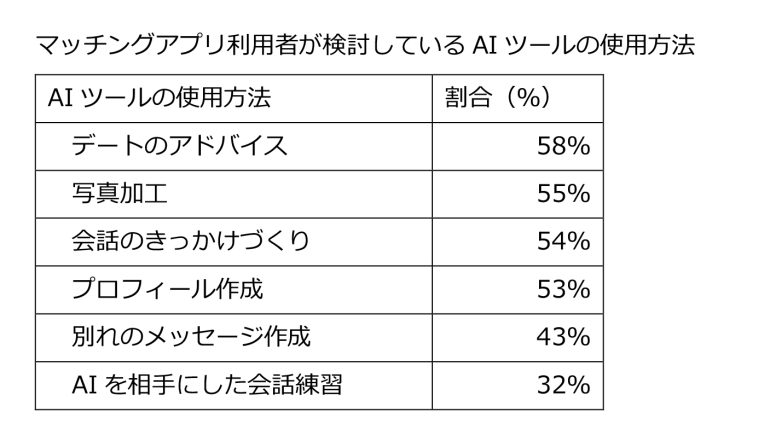

今回の調査では、相手がAIを使用した写真や音声メッセージを使用していると見破ったり気付くことができると36%が回答。AIや写真加工ツールを使って写真加工していることが気になるかについては、73%が気になると回答した。『Synthesia』や『CreatifyAI』などのAIアバターについても25%が使用したことがあると回答しているという。マッチングアプリを使用している人では、半数以上がAIを使用していると回答。プロフィール作成やデートのアドバイス、写真加工、会話のきっかけ作りなどにAIツールを使うことを検討していた。

マッチングアプリに関連して、さびしさを感じた時にAIチャットボットに話かけるか質問すると9%が話かけたことがあると回答した。孤独やさびしさの解決にAIを利用する人が意外と多いと感じさせる結果が出た。

AI活用によるプライバシーリスクの理解が必要

広く使われているAIツールは、毎年のセキュリティ監査、暗号化、厳格なアクセス制御などのセキュリティ対策が組み込まれているものもあるが、いまだにデータ漏洩やフィッシング詐欺やマルウェア開発などのリスクがあると言われている。一般的なAIツールがどのように個人データを収集して使用しているかを理解しておくこともAI利用の重要なポイントになるはずだ。

AIツールは、進化とともに伴うリスクも日々変化しており、AIを用いた精巧なフィッシング詐欺やマルウェアの高度化も進行しており、セキュリティ上の脅威は深刻化しているという。さらにAIが生成する虚偽コンテンツによる誤情報の拡散も社会的な懸念のひとつとなっている。ちなみにAI利用時に理解しておくべき基本項目には次のようなものがあるという。

•自然言語処理の向上と履歴の活用

AIとのやりとりはチャット履歴の保存を無効にしない限り自動的に保存され、システムの改善に使用される。

•第三者との共有

一部のプラットフォームは、 消費者のデータを販売していないにも関わらず、「信頼できるサービス・厳選されたプロバイダーのグループ」と情報を共有していることがある。個人情報が知らないうちに他企業へ転送されている可能性もある。

•データの保存と保持

保存されるデータは個人が特定されないように匿名化され、各国のデータ保護規制に則って安全に管理されている。

AIによるプライバシーリスクの対応策

ノートンのAI・イノベーション担当ディレクターのイスカンダル・サンチェス=ローラ氏は、AIツールを使用する場合に用心するべきポイントや安全対策について次のようにアドバイスしている。

•機密情報の共有を避ける

AIツールとの対話では、プライベートな情報や機密情報を共有しないこと。

•プライバシーポリシーを確認する

AIプラットフォームで利用者の情報がどのように扱われ、保存されるかを常に確認し、理解しましょう。

•強力なパスワードを使用する

強固でユニークなパスワードを使って、アカウントの安全性を確保しましょう。

•最新の脅威を理解すること

常にAIやサイバーセキュリティの最新動向を把握し、詐欺や脅威に巻き込まれないようにしましょう。

•安全のためにセキュリティソフトを使用する

ノートンなどのセキュリティソフトを利用することで、マルウェアの脅威からデバイスの保護を強化しましょう。

さらにイスカンダル・サンチェス=ローラ氏は、いま話題になっているジブリ風の生成画像にまつわる最新トレンドに関しても回答している。

「考えるべき重要な点は、AIが生成した画像内のテキストがどのように改善されているかということです。プライバシーの観点から、特定の写真を投稿する際に以前は慎重だったとしても、今はさらに慎重になるべきです。例えば学校の前にいるお子さんのジブリ風の画像はとても真新しいものとして魅力的に見えるかもしれませんが、無意識の内にお子さんの学校名を公開している可能性もあります。また以前のAIモデルは、内容が歪んだり読み取れなかったりと画像中のテキストを処理するのが難しかったですが、AIの進歩でこれらのテキストが正確に再現できるようになり、学校名やロゴ、道路の名前などの詳細な情報がより見やすくなりました。学校名やロゴが背景や制服に表示されても判読できるようになってきています。消費者は、画像にロゴや目に見えるテキストを含めないようにするか、生成された画像からロゴなどを削除するように指示するなどといった対応が必要になります。AIによる画像生成ツールは革新的な手段である一方で、消費者は自覚のないままに個人情報を共有してしまうリスクがあります。AIの技術が進化し続ける今、これらのツールを使う際には、どのような情報が共有されうるのかを正しく理解し、特にプライバシー保護の観点から慎重に活用することがこれまで以上に求められています」

AIツールはさまざまな業界を大きく変えていく可能性を持っているが、一方でセキュリティリスクなどを考えると消費者は慎重に使用することが重要だ。AIのツールや最新トレンドを活用する時は、さまざまなリスクを回避するためにもプライバシーの保護に配慮して、対策することを心がけよう。

「ノートン サイバーセーフティ インサイトレポート」調査概要

今回の調査は、DynataがGenの委託を受けて、18歳以上の成人1000人を対象に2024年12月5日から2024年12月18日までの期間、日本国内においてオンラインで実施したもの。データは全国を代表するものとなるように、必要に応じて年齢、性別、地域別に加重平均している。

構成/KUMU

DIME MAGAZINE

DIME MAGAZINE