検索から日常サポートまで!Pixel 9で試す万能AI「Gemini」の超便利機能と初心者が戸惑う〝使いこなしの壁〟

2025.05.17

iPhone 15 ProやiPhone 16シリーズを「Apple Intelligence」に対応させたアップルだが、競合となるグーグルも早くからAIに力を入れている。Androidの多くは、生成AIのGeminiに対応。一部のモデルは、Geminiアプリ内からライブ動画や画面を共有しながら話せる「Gemini Live」も利用可能だ。単体のアプリとは別に、Geminiを画面上に重ねて表示させて、指示を出すこともできる。

また、グーグルは純正アプリの一部にもGeminiを組み込んでおり、企業向けのGoogle Workspaceの上位プランや、Google Oneの「AIプレミアム」に加入しているユーザーであれば、「Gemini in Gmail」や「Gemini in Googleドキュメント」などの機能をスマホで活用できる。いずれもクラウド上で動作するAIだが、Pixelなどの一部モデルは、デバイス上で動作するGemini Nanoも組み込まれており、レコーダーの要約などで使える。

一方で、アップルのApple Intelligenceやサムスン電子のGalaxy AIのように、AI関連の機能をひとまとめにしているわけではないため、何ができるのかが少々分かりづらいのも事実。そこで今回は、グーグル純正スマホの標準モデル「Pixel 9」を例に取りつつ、AndroidにおけるGeminiの機能をレビューしていく。

Android標準の生成AIとして搭載されているGemini。その機能がスマホでどこまで使えるかをレビューしていく。写真はPixel 9

Android標準の生成AIとして搭載されているGemini。その機能がスマホでどこまで使えるかをレビューしていく。写真はPixel 9

ライブ映像で受け答えが可能になったGemini Live、Geminiの回答も優秀

Androidは多くのモデルに、Geminiがアプリとしてプリインストールされている。基本的な機能はWebで提供されているGeminiと同じで、チャット型の生成AIという位置づけ。ユーザーが問いかけたことに対し、賢い回答を返してくれる。アプリ版は、Geminiに使われるAIモデルを切り替えることが可能。標準は軽量で素早い対応ができる「Gemini 2.0 Flash」だが、より詳細な調査を依頼したいときには「Deep Reserch」を呼び出すこともできる。

Geminiは多くのAndroidスマホにプリインストールされている。基本的な使い勝手はWeb版とほぼ同じで、チャット形式でやり取りするというもの

Geminiは多くのAndroidスマホにプリインストールされている。基本的な使い勝手はWeb版とほぼ同じで、チャット形式でやり取りするというもの

また、現在時点ではより高速な処理に対応した「Gemini 2.5 Flash」や、推論、数学、コーディングなどを得意とする「Gemini 2.5 Pro」もプレビューとして提供されている。ユーザーの検索履歴を使ってパーソナライズされた「Gemini 2.0 Flash Search history」も用意されている。同じGeminiでも、どのAIモデルを選択するかで、回答は異なる。

同じGeminiでも、どのAIモデルを選択するかで回答が変わってくる

同じGeminiでも、どのAIモデルを選択するかで回答が変わってくる

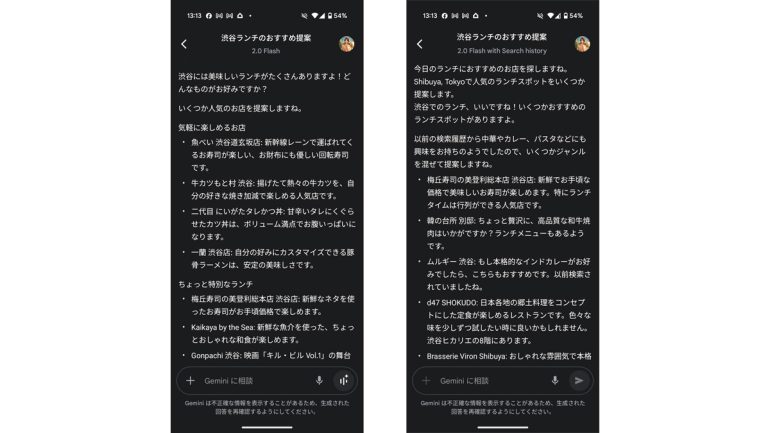

例えば、「今日のランチのお勧めは?」と聞いたとしよう。通常の2.0 Flashでは、現在地に基づいて、筆者がいた渋谷周辺のお店をシーン別にピックアップしてくれた。「気軽に楽しめるお店」「ちょっと特別なランチ」「その他」といった具合に、数店舗ずつ、ランチが食べられそうなお店が選択された。

これに対し、検索履歴を活用するSearch historyを選択したところ、筆者が中華やカレー、パスタなどをよく検索していたことを利用して、そのジャンルに合った渋谷周辺のお店がピックアップされた。こちらは、食べログやNAVITIMEといった他社サービスへのリンクも張られており、より実用的だ。

左が2.0 Flash、右が2.0 Flash Search history。検索履歴を活用している方が、より好みに近い結果が出る

左が2.0 Flash、右が2.0 Flash Search history。検索履歴を活用している方が、より好みに近い結果が出る

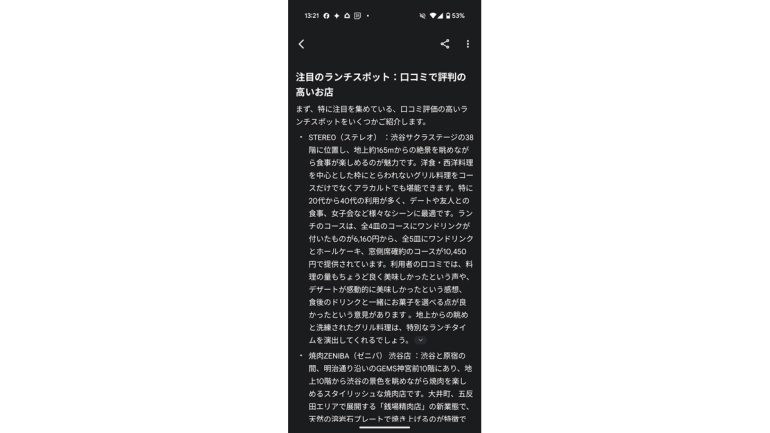

ここまではライトな例だが、Deep Researchを使うと、Geminiがネットの様々なサイトにアクセスして、本格的に調べ物をしてくれる。AIにランチの相談をするのに、ここまで徹底的に調査する必要があるのかとツッコミを入れたくなりそうだが、結果は実に本格的。渋谷のランチのお勧めを紹介する20以上のサイトを調べて、結果をレポートとしてまとめてくれる。完成したレポートを見ると、どちらかと言えば、気軽に何かを質問するというより、ネット上で語られているお勧め店をまとめた読み物に仕上がっている。

Deep Reserchは、本格的な調べ物をする際に活用する機能。20近いサイトを横断して、情報をきっちりまとめてくれる

Deep Reserchは、本格的な調べ物をする際に活用する機能。20近いサイトを横断して、情報をきっちりまとめてくれる

ランチのお勧めをAIとの雑談で決めるためだけにDeep Researchを使う必要はないが、事前に市場調査や関係法令の調査、技術調査などをしたいときには、Deep Researchが活躍する。筆者の関心に寄せた例を挙げると、「ドコモの最新料金プランを導入した狙いや戦略」といった質問や、「グーグルがPixelを手がけている理由」のような形の調査をしたいときには、Deep Researchの出番だ。

音声でGeminiとやり取りする「Gemini Live」も、Geminiアプリから呼び出せる。こちらは、雑談するもよし、何か質問するもよしで、検索代わりに活用できる。グーグルが生成AIに取り組んでいるのも、将来的にはAIが検索を置き換える可能性があるとにらんでいるからだろう。実際、筆者も薬の効用を尋ねるときや、ポーチについてしまったボールペンの汚れの取り方など、さまざまなことをGemini Liveに尋ねている。

リアルタイムにAIと会話できるのがGemini Live。雑談ができるのはもちろん、検索代わりに調べ物をしたいときにも話し相手になってくれる

リアルタイムにAIと会話できるのがGemini Live。雑談ができるのはもちろん、検索代わりに調べ物をしたいときにも話し相手になってくれる

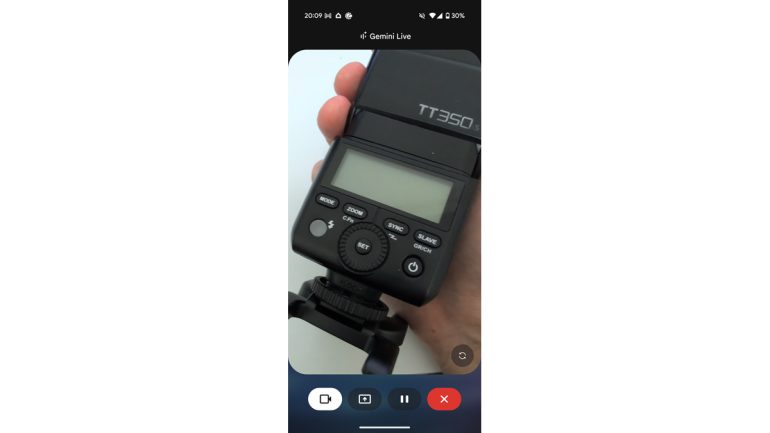

このGemini Liveに加わった新機能が、ライブ映像だ。現在はPixel 9シリーズやGoogle OneのAIプレミアムに加入しているユーザーが対象。カメラで映し出したものについて尋ねたり、スマホの画面を表示させて操作をたずねたりといったことができる。カメラで表示させたものは記憶しているため、あとから、「さっき写ったイヤホンのメーカーは?」「壁紙の色は何色だった?」といった質問にもきちんと回答してくれる。また、カメラなどの製品を見せながら、操作方法を聞くといったことも可能。これらの機能は、スマホならではだ。

映像を見せながら、Gemini Liveと会話が可能。家電の操作方法をたずねたり、複数ページにまたがるメニューを見せながらお勧めを考えてもらったりと、使い方の幅が広がる。画像はカメラのフラッシュだが、使い方や設定方法を実際に操作しながら聞くことができた

映像を見せながら、Gemini Liveと会話が可能。家電の操作方法をたずねたり、複数ページにまたがるメニューを見せながらお勧めを考えてもらったりと、使い方の幅が広がる。画像はカメラのフラッシュだが、使い方や設定方法を実際に操作しながら聞くことができた

スマホの画面を見せながら、会話することも可能。操作方法が分からないときなどのヘルプとして役に立つ

スマホの画面を見せながら、会話することも可能。操作方法が分からないときなどのヘルプとして役に立つ

電源キーの長押しで起動するGeminiは要約やアプリ連携などにも対応

アプリとしてだけでなく、Geminiは、以前のGoogleアシスタントのように、ホーム画面や起動中のアプリに重ねるような形で呼び出すこともできる。起動方法は機種によって異なるが、Pixelシリーズの場合は電源ボタンを長押しするだけ。この操作方法にならっているAndroidスマホは多く、画面左右の下からスワイプで呼び出していたスマホも、徐々に移行している。Galaxyの場合、「Galaxy S25」シリーズから、電源キーの長押しでGeminiを呼び出せるようになった。

電源キーの長押しで、ホーム画面やアプリに重なるような形でGeminiが起動する

電源キーの長押しで、ホーム画面やアプリに重なるような形でGeminiが起動する

こちらも、アプリを起動するのと同じようにチャットで質問することが可能。また、音声のウェイクワードによる起動にも対応しており、「OK、グーグル」と呼びかけると、そのまま音声で質問できる。簡易的な質問をするのであれば、声で済ませてしまった方が楽だ。ただし、アプリを直接起動するのとは異なり、AIモデルは指定できず、Gemini Flash 2.0が使われる。質問に合わせてモデルを変えたいシーンではなく、即座に回答がほしいという時に呼び出すものと理解しておくといい。

以前は同様の操作でGoogleアシスタントを起動できたが、グーグルは、Android標準のアシスタントをGeminiに置き換えている。当初はGoogleアシスタントで家電を操作するときなどに使う「ルーチン」に対応していないなど、機能に差分があったが、現在ではそのままGeminiからGoogleアシスタントを呼び出す形でこれに対応した。Google Homeで設定しておけば、照明を消したり、テレビをつけたりといったことがスマホから行えて便利だ。

筆者は、朝起きたときに「おはよう」というだけでリビングの電気をつけて天気予報を読み上げ、 最後にテレビをつけるように設定している。テレビにはスマートリモコンを活用し、それぞれのボタン操作にルーチンを割り当て、音声でチャンネルを変更できるように設定。寝っ転がりながらスマホに話しかけるだけでよく、スイッチやリモコンをわざわざ押すかつての習慣には戻れなくなってしまった。

画面に表示されていることを元に、Geminiに何かをたずねる時にも、こちらの方法で呼び出した方が操作が簡単。スクリーンショットを取ってGeminiアプリを起動し、アップロードするより直感的だ。特に便利なのが、アプリ連携。例えば、Gmailで打ち合わせの予定が送られてきたとする。この時、Geminiを起動し、「画面について質問する」をタップすると、その情報が送られる。あとは、キーボードなり音声なりで「この予定を登録して」というと、カレンダーにその予定が受け渡される。

「画面について質問する」をタップしたあと、「この予定を登録して」と入力したところ、Googleカレンダーに時間と場所、用件が登録された

「画面について質問する」をタップしたあと、「この予定を登録して」と入力したところ、Googleカレンダーに時間と場所、用件が登録された

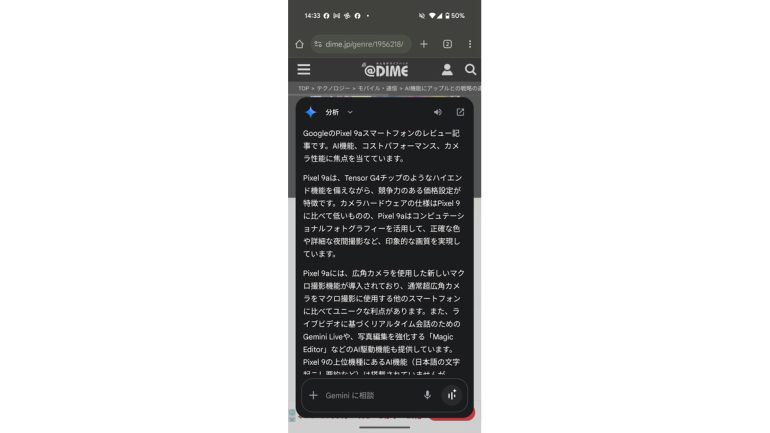

また、「画面について質問する」は、記事の要約などにも活用できる。試しに、筆者が執筆した本サイト上の「Pixel 9a」に関する記事を開き、Geminiに画面を送ったあと、「この記事を要約して」と頼んでみたところ、適度な長さに中身がまとめられた。筆者の主張だけをまとめてもらうこともできた。表示されている画面だけでなく、URLを読み込んで記事全体を解釈しているようだ。

画面上に表示されている記事などの要約にも利用できる。画像は、Pixel 9aのレビューを要約したところ

画面上に表示されている記事などの要約にも利用できる。画像は、Pixel 9aのレビューを要約したところ

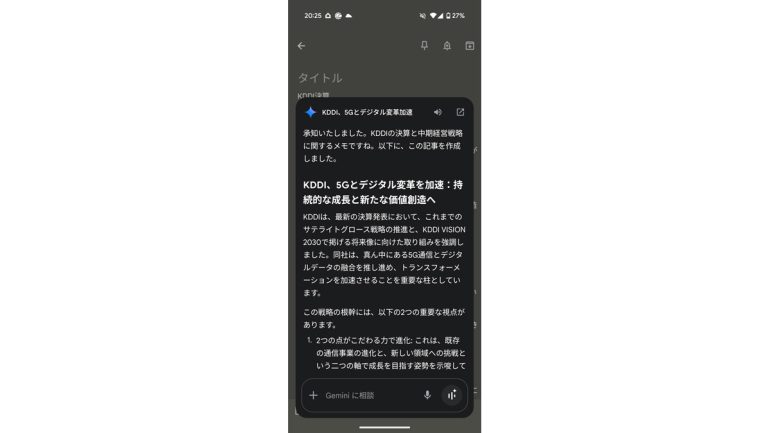

Google Keepに取った箇条書きに近いメモを元に、文章を書いてもらうことも可能だ

Google Keepに取った箇条書きに近いメモを元に、文章を書いてもらうことも可能だ

同様のことは、YouTubeの動画でもできて活用すると時短につながる。iPhoneのApple Intelligenceの場合、アプリごとにこうしたAIが組み込まれているが、Androidのそれは、とりあえずGeminiを起動するだけで汎用性が高い。半面、できること、できないことの区別がユーザー側につけづらいのが難点。AIに頼みたいことがあったら、まずはGeminiを起動してみるのをクセにした方がいいかもしれない。

アプリ内にも組み込まれるGemini、活用提案が今後の課題か

GmailにGoogleカレンダー、Googleドキュメントと、多彩なサービスを提供しているグーグルなだけに、こうしたサービスにもきちんとGeminiが組み込まれている。こちらは有料サービス限定だが、ワンタッチでGeminiを呼び出せて便利だ。Androidアプリが対応しているのはGmail。メールの返信を書いてもらいたいとき、Gmailアプリでメールを開いた状態でGeminiボタンを押し、その旨をチャット欄に入力すればいい。

筆者は、この機能をイベントなどへの参加を表明するときに活用している。案内のメールが来たら、それを開いた状態でGeminiボタンをタップし、入力欄に「参加の旨を返信」と書くと、メールの相手の情報などを踏まえた形で文章が作成される。また、所属や連絡先など必要事項を記載しなければならないケースでは、「返信フォーマットも満たす」と補足するといい。

メールの中身を踏まえたうえで、こちらの意図を文章にしてくれた。これなら、電車の中などでサッと長めの文章を書くことができる

メールの中身を踏まえたうえで、こちらの意図を文章にしてくれた。これなら、電車の中などでサッと長めの文章を書くことができる

残念ながら、Geminiは細かな個人情報まで参照できないうえに、長期記憶もないため、返信欄が空欄だったりダミーの情報だったりで埋められてしまうことが多いが、ここを手直しするだけで相手に送れるのは時短につながる。少なくとも、ゼロベースでメールを書いたり、コピー&ペーストで返信フォーマットを引用したりといった手間は省ける。

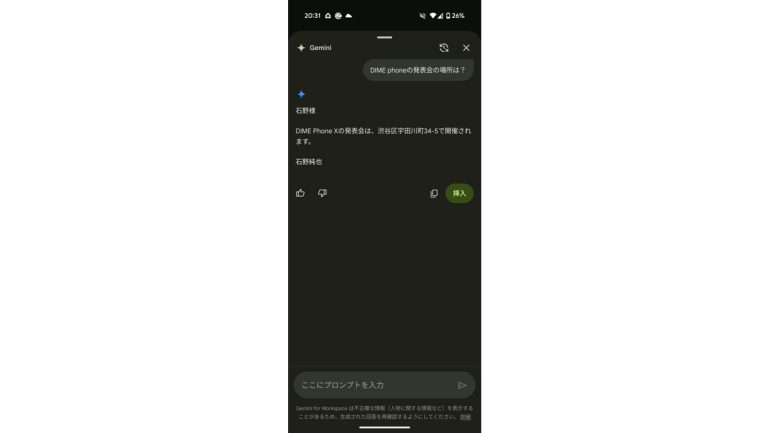

また、大量に来たメールの中から、特定のやり取りだけをピックアップしてもらうというのもお手の物。検索でもメール自体は探せるものの、より自然な言語で必要なメールの内容だけを抜き出してくれる。例えば、「○○○社の直近の決算説明会はどこ?」と聞くと、メールをソースにして場所だけを抽出した回答が返ってくる。時間を聞くのにも便利だ。

メールを自然言語で調べて、必要な情報だけを表示させることが可能だ

メールを自然言語で調べて、必要な情報だけを表示させることが可能だ

一方で、同じ質問をしてもメールによってはうまく反応してくれないことも。複数のメールを横断して、それを箇条書きにさせるような命令も、比較的失敗が多い印象だ。例えば、「小学館の石崎さんと今月やり取りしたメールをまとめて」と言っても、別の石崎さんからのメールを混ぜたり、過去の内容が混ざっていたりで正確な内容にならなかった。何ができて、何ができないのかが少々分かりづらいのが、この機能の難点。いきなり文章を入力するのではなく、メニューの中から選択肢を選べるような形になっていた方が使い勝手はよくなりそうだ。

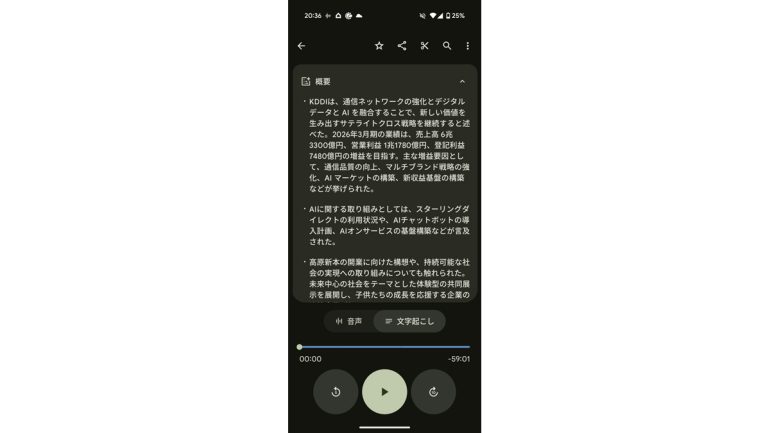

ここまで挙げてきたのはいずれもクラウド側で対応しているため、幅広い端末で利用できるのがメリットだ。ただ、プライバシーに配慮しなければいけないやり取りについては、できればデバイス上で完結させたい。このような時には、Gemini Nanoが活用できる。と言っても、Gemini Nanoはメーカーがどのように実装するか次第。Pixel 9では、ボイスレコーダーの要約や、「Pixelスクリーンショット」というアプリがGemini Nanoで動作する。

ボイスレコーダーの要約は、長めの会議の要旨をギュッとまとめて把握したいときに役立つ。文字起こしの誤字脱字に引きずられてしまう側面はあるが、デバイス上で処理したとは思えないほど内容は過不足なくまとめられている。

Pixel 9aを除くPixel 9のボイスレコーダーは、要約に対応している。比較的長めの会議を文字起こししたあと要約すると、内容がコンパクトにまとまって理解が進む

Pixel 9aを除くPixel 9のボイスレコーダーは、要約に対応している。比較的長めの会議を文字起こししたあと要約すると、内容がコンパクトにまとまって理解が進む

対するPixelスクリーンショットは、文字通りスクリーンショットの中身をGeminiが解析してくれる機能。レストランの情報を取りためておいて後から必要なものを検索したり、イベントのメールを記録しておいて日程や場所を調べたりという時に活躍する。ただ、これは日ごろからスクリーンショットで情報を残しておくクセをつけなければならず、利用シーンが限定される。

スクリーンショットを解析して、内容を検索できた。使いこなせば便利な機能ながら、そもそも情報をスクリーンショットとして取りためておく必要がある

スクリーンショットを解析して、内容を検索できた。使いこなせば便利な機能ながら、そもそも情報をスクリーンショットとして取りためておく必要がある

全体を通して気になったのは、できないこととできることの線引きが分かりづらいところ。画面に重ねるGeminiを使えば、画面内の情報を元にした文章作成や要約なども一通りこなせるが、逆にそれを自分で発見する必要があるため、初心者にはとっつきにくい。こうした見せ方は、同じスマホのAIだとApple IntelligenceやGalaxy AIなどの方が一枚上手。アプリごとに何ができるかが明確で、活用がしやすい。とりあえずGeminiを呼び出せばいいAndroidやPixelのAIだが、その先にどうつなげていくかは今後の課題と言えそうだ。

文/石野純也

DIME MAGAZINE

DIME MAGAZINE