中国のスタートアップ企業「DeepSeek」社が開発した生成AI「DeepSeek」が社会から注目を集めるようになり、1か月余りがたった。

米国や日本をはじめ様々な国や会社が利用禁止にしていることに加え、「ChatGPTの言語モデルよりコスパが良すぎる」「データが中国に保存されている」「DeepSeekの利用ユーザーのデータが第三者に見える状態に」・・・と、各メディアが報じ、またセキュリティに造詣ある専門家たちが、“リスクがある”と警鐘を鳴らしているため、@DIME読者のみなさんも気に留めているのではないだろうか?

では、“仕事で生成AIをよく使っているビジネスパーソン”が認識しておくべきリスクは何だろう。本記事で理解を深めてもらいたい。

こんなに世間を賑わせた理由は「コスパが桁違いに良すぎる」から

DeepSeekとは中国・杭州市にあるAIスタートアップ企業で、大規模言語モデル開発の高品質・低コスト戦略で注目を集える。2023年に梁文鋒氏(1985年生まれ・起業家)によって設立され、AI取引アルゴリズムで成功したヘッジファンド「幻方量化」の資金支援を受け急成長した。

また、ソリューションであるDeepSeekは、オープンソースとして公表されており、そのソースコードがGitHubから入手できる。

参考: DeepSeekのオープンソースのひとつ DeepSeek Math

2022年末くらいから、chatGPTが有益だとして生成AIブームが巻き起こってから、2年がたったので、「高性能なAIがリリースされた」の報道くらいでは、社会はほとんど見向きもしない。

しかし、1月の最終週(1/27週)に、米国の株価市場に悲劇が起こった。AI関連の株価が総じて大幅に下落したのだ。

下落幅は2020年3月のコロナショックに匹敵するほどの影響で、例えば半導体大手のNVIDIA(エヌビディア)は、27日に約17%も株価が下落し、時価総額で約6000億米ドル(約90兆円)が失われた。

前営業日の1/24の株価が142.62米ドルだったのに対し、1/27には118.42米ドルまで急落した

その原因は、OpenAIと比較してDeepSeekにかかるコストが約25分の1と破格のためだとみられる。AIを利用するときには、「トークン」という文字テキストを刻んだ単位で処理を行なうのだが、100万トークン当たりの利用コストは、openAIが約75米ドルなのに対しdeepsheekは約3ドルしかかからない。

つまり、高性能な生成AIの言語モデルをできるだけ安く使いたい企業からすれば、DeepSeekが魅力的に見えた結果、OpenAIが価格競争で負けてしまい、これらの市場を形作る米国の半導体市場が暴落したというわけだ。

コスパの良さに比例して「リスクも高い」のが現状

こんなにコスパが良いのだから、今すぐchatGPTからDeepSeekに乗り換えても良さげだが、実際はそうではない。

国内外で利用に関する注意喚起や利用禁止措置を講じる例が増えており、当然、日本の経済安全保障に関するリスクがあるのは自明だ。加えて技術・機能面にもリスクがあることを認識したい。

デジタル庁が2025年2月6日に公表した通達資料と、個人情報保護委員会の資料によれば、デジタル庁は、“各政府機関等におかれては、DeepSeek 等の生成 AI の業務利用に当たってはサービスの利用によって生じるリスクを十分認識の上、内閣サイバーセキュリティセンター及びデジタル庁に助言を求めた上で適切に判断”(一部略)すべしと通達している。

また個人情報保護委員会は、“日本国内でサービス提供体制が構築されている他のサービスとは異なり、留意すべき点”があり、“DeepSeek社が取得した個人情報を含むデータは、中華人民共和国に所在するサーバーに保存され、同国の法令が適用される”と述べている

明確に【利用禁止】との記述がないので憶測になるが、個別にDeepSeekの件を言及しているので、余程のことがない限り利用はできない。また民間企業に対しても同じくらい慎重になるべきとの含意があると読み取った。

実際にDeepSeekのプライバシーポリシーを見てみると、生成AIで結果を出力するために必要なテキストデータやファイルをはじめ様々な情報を収集し、中国のサーバーに保存していることがわかる。

それぞれの項目をchatGPTなどの他の生成AIと比べると種類が多くなっているのだが、収集している情報をきちんと明文化しているとも見えるし、生成AI利用に対して不釣り合いなほど情報を収集しているとも見える。

やはりデジタル化が進む社会で他国にデータが保存された場合、企業のビジネス面でも国の政治面でも様々な軋轢が生まれてしまうし、

“中国の個人情報保護法は、国家との関係では、後述のとおり、国家安全が強調され、国家として、個人情報に強い関心を持っている。(出典:総務省の学術雑誌『情報通信政策研究』の寄稿論文)”

と、あるように、中国では国家が個人情報、ひいてはデータに関心を持っているならば尚更で、保存されたデータを活用してサイバー攻撃をしかけるなどの行為を行いやすくさせてはいけない。ということである。

DeepSeekが持つ利便性よりも、セキュリティ面や技術・機能リスクに目を向けて

2025年1月29日付けのbloombergの報道では、DeepSeekがオープンAIのデータを不正に入手した疑惑がある。「蒸留」という手法により、大規模な言語モデルであるOpenAIの出力結果を使って、DeepSeekのモデル学習に利用したと報じられている。

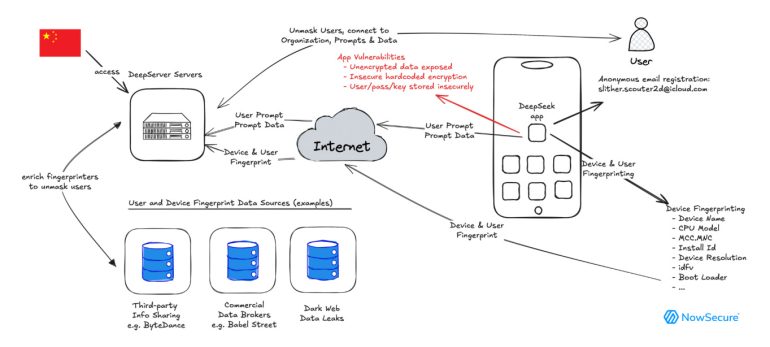

また、DeepSeekには、セキュリティの脆弱性が数多くあることも報じられている。例えば米国のセキュリティ企業NowSecure社は、DeepSeekのiOSアプリに、データを暗号化せずに通信し、また第三者が複号できる状態の暗号方式を利用していると指摘している

(出典:NowSecure Uncovers Multiple Security and Privacy Flaws in DeepSeek iOS Mobile App)

(出典:NowSecure Uncovers Multiple Security and Privacy Flaws in DeepSeek iOS Mobile App)

ほかにも、本来第三者に見えてはいけないはずの、データベースが閲覧可能になっており、入力したチャットの履歴が漏洩する懸念などが報告されている。

言語モデルとして性能が高く安く使えたとしても、セキュリティ性能が低かったり不正に得たデータを使っていたりしては、コンプライアンス的に不健全な状態なので、利用は避けたほうがよいと言わざるを得ない。

DeepSeekの利用を控える場合、他サービスのAPI利用にも気を付けたい

DeepSeekの利用には、経済安全保障的リスクと技術・機能的リスクの2つがあり、利用を控えておいたほうが無難だ。モノ自体は安くて質が良さそうに見えるだけに、今後のこれらのリスクが改善されて、誰もが安全・安心に使えるようになってもらいたいところなのだが。

DeepSeekに限らず、開発元やデータ保存先が不明確な生成AIサービスを利用するのは、どんなに便利そうに見えても、すぐに利用するのは悪手だと改めて認識してほしい。また、仕事で利用するときは、社内のセキュリティ部門に問い合わせをし、情報漏洩リスクなどが低減出来ていることを確認してから使おう。

最後に、DeepSeekの利用を控えようと考えている人に、1点注意喚起しておこう。

DeepSeekの本丸サイトやアプリでなくとも、APIなどで組み込まれているDeepSeekを意図せず使ってしまうことがある点だ。

出典:perplexity

出典:perplexity

例えば、生成AIを検索エンジンと同じように使えるサービス「perplexity」では、利用する言語モデルが選択できるが、その中に「DeepSeek」が含まれているので誤って選択しないよう気を付けて欲しい。

文/久我吉史

DIME MAGAZINE

DIME MAGAZINE