アップルは、2024年6月11日(日本時間)に「WWDC 2024」を開催。iPhoneやiPad、Mac、Apple Watchといったデバイスに搭載されているソフトウエアの最新アップデートを、一挙に公開しました。

本記事では、WWDC 2024にて発表された最新情報から、注目の新機能をピックアップしてご紹介します。

いま話題の「AI」でアップルは何をする?

グーグルやサムスンがスマホに搭載しているように、最新デバイスとAIはもはや切っても切れないもの。アップルも例にたがわず、パーソナル人工知能システム「Apple Intelligence」を発表。iOS 18、iPadOS 18、macOS Sequoiaに組み込まれます。

Apple Intelligenceには、大規模言語モデルが備えられているため、言語や画像を理解して生成したり、複数のアプリ間での操作を簡単に行えるようになります。

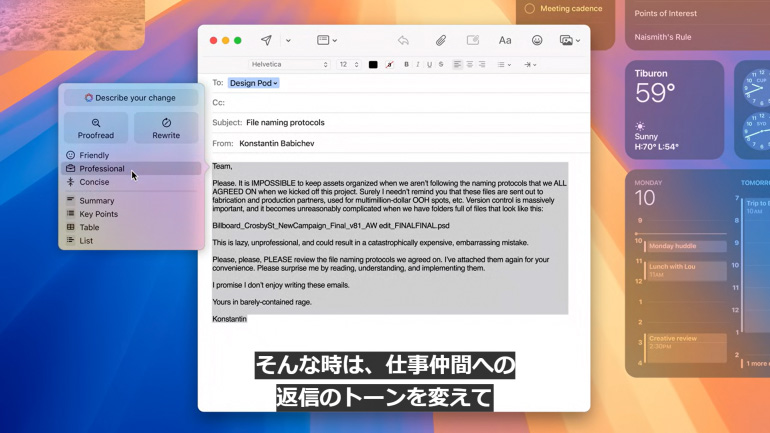

通知が届いた際に、優先順位が高いものを目立たせて表示したり、文章の書きなおしや校正も可能。相手に合わせ、メールの返信を自動的に作成してくれる機能なども利用できます。

また、従来のメールボックスでは、プレビュー画面にメールの冒頭が表示されていましたが、Apple Intelligence対応デバイスであれば、メールの内容を解析し、要約文を表示してくれます。メールを開いた際にも、上部に要約が表示されるので、内容を一目で確認できます。

メモやメッセージ、フリーボードといったアプリでは、テキストを入力して画像を生成可能。スケッチ、イラストレーション、アニメーションの3パターンが生成でき、テキストからオリジナルの絵文字生成も可能です。

撮影した写真から人物や物を取り除いたり、逆にステッカーを写真に貼ることもできます。

また、メールやカレンダーといった、複数のアプリに記録されている情報から、ユーザーが探しているものをすぐに検索可能。効率的にデバイス内の情報にアクセスできます。

iPhone 15 Pro、iPhone 15 Pro Maxに搭載されるA17 Proと、iPadやMacに搭載されているMシリーズのチップセットには、演算処理の基盤が搭載されているため、多くのAI機能はオンデバイスでの処理が可能。セキュリティ面にも配慮されています。ただし、一部デバイスで処理しきれない場合は、クラウドサーバーを併用して処理します。

Apple Intelligenceの対応機種は、iPhoneならA17 Pro搭載のiPhone 15 Pro、iPhone 15 Pro Maxが、iPadやMacはM1~M4搭載のモデルに限定されます。つまり、A16以前のチップセット搭載モデルには対応しません。

音声サポート機能であるSiriも進化し、少しの言い間違えや言いよどみが合っても、自然に対話ができるようになります。

また、前の会話からユーザーの意図をくみ取れるようになっているため、〝そこ〟といった指示語を使った会話もできますし、複数のアプリに散らばっている情報や、Webから集められるアクティブな情報を統合して、最適な出発時間を教えてもらうといった使い方も可能。

さらに、SiriにはChatGPT 4oが組み込まれており、専門知識の検索や文章の作成、画像の生成もできます。

DIME MAGAZINE

DIME MAGAZINE