先日京都で開催された国連主催によるインターネットの国際会議「IGF(インターネット・ガバナンス・フォーラム)」では、生成AIに関する議論が大きく取り上げられた。ここではその内容を紹介する。

*前編はこちら

世界で強まるディープフェイクへの警戒感

IGF 2023では “Internet We Want – Empowering All People -”(私たちの望むインターネット -あらゆる人を後押しするためのインターネット-)という全体テーマが掲げられ、8つのサブテーマのもと、多様なステークホルダーが主催する355のセッションが開催された。その中で最も大きく取り上げられたのが、日本でも話題の生成AIをテーマにした議論だ。

AIの開発は1950年代から行われており、Googleをはじめ多くの企業からサービスも提供されている。最近登場した大規模言語モデル(以下、LLM)を用いた生成AIは、これまでのチャットボットとは比べ物にならないほど性能が高いが、時には誤情報をもっともらしく回答するハルシネーションを起こすといった問題が指摘されている。

さらに誰でも簡単にツールを使って情報をねつ造できるディープフェイクの問題は深刻で、日本でも岸田首相のフェイク動画が拡散されたことがニュースになった。2016年の米国大統領選挙でも使われていたフェイクニュースの精度をさらに高めたものが来年の選挙で使われ、他の国でも同様の被害を受けるのではないかという警戒感が強まっている。

IGFでAIをテーマにした特別セッションが行われるなど、AIをテーマにした議論が目立っていたのは、そうした背景が影響していると思われる。

安心安全で透明性が高いAIをどう実現するか

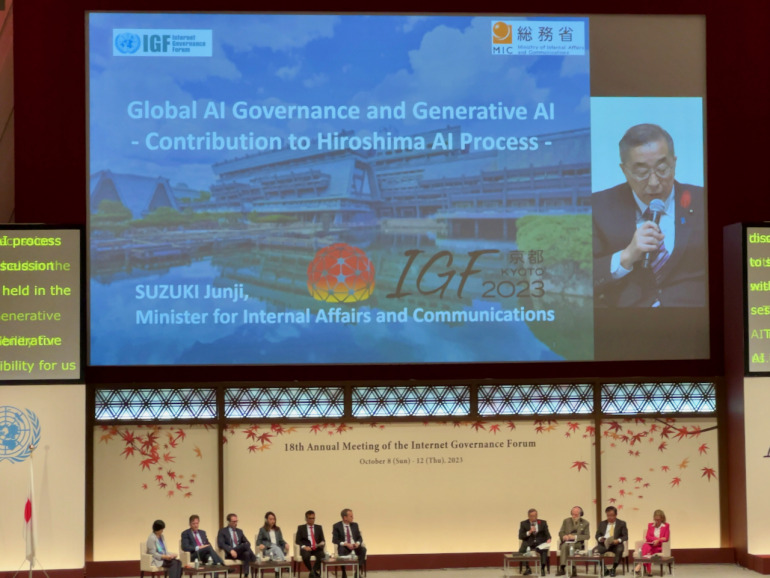

特別セッションは開会式から再び登壇した岸田文雄首相のメッセージで始められた。最初のプレゼンテーションに登壇した鈴木淳司総務大臣から、今年5月のG7広島サミットで立ち上げられた「広島AIプロセス」について、生成AIの開発や活用に関する国際ルールを年末までに策定することが紹介され、日本が中心となって問題に取り組んでいることがアピールされた。

続くパネルディスカッションは、インターネットの通信方式「TCP/IP」を開発したことからインターネットの父と呼ばれ、グーグル副社長兼チーフ・インターネット・エヴァンジェリストでもあるヴィント・サーフ氏や、日本のインターネット父として知られる慶応義塾大学教授の村井純氏、ITU事務総長のドリーン・ボグダンマーティン氏といった人物が参加し、インドネシア、ブラジル、シンガポールでIT関連の政策などに関わる有識者に加えて、テック企業を代表してGoogleとMetaが参加した。

AIをテーマにした特別セッションには様々な立場から様々な意見が出された。

AIをテーマにした特別セッションには様々な立場から様々な意見が出された。

いま世界では安心安全で透明性が高く、社会に与えるリスクを軽減するAIの実現が期待されている。そのためには企業を含むステークホルダーが情報を共有し、機能と限界をそれぞれ明確に評価し、同時にAIで生成されたコンテンツを識別できる仕組みとして、出所を明確にする電子透かしといった技術の開発も必要だという意見が出された。

DIME MAGAZINE

DIME MAGAZINE