Googleの検索エンジンといえば、アメリカ・日本のみならず世界中で利用されている超大型検索エンジン。日常的に使っている人が多いのではないでしょうか。

そんなGoogleの検索技術の大型アップグレードが、2020年10月16日(日本時間)に、発表されました。

もはや私たちの生活に強く根付いている「Google検索」ですから、便利に進化することで恩恵を受けるユーザーは多いでしょう。では、実際にどのようなアップグレードが行われたのかをまとめていきたいと思います。

Google検索はどう変わる?

では、発表会内で紹介された新しいGoogleの検索技術について紹介していきましょう。

Google Mapは周辺店舗の混み具合がリアルタイムで確認できるように!

まずは、Google Mapの新機能について。Google Mapには、これまで特定の店舗や施設が、どの時間にどれくらい混み合うかを表示する機能がありました。これがさらに進化し、リアルタイムで、どこがどれくらい混み合っているのかを確認できるようになります。

また、行きたい店舗・飲食店などを選択すると、そのお店がマスク着用を義務付けているのか、感染症対策はどのレベルで行われているのかも表示されるようになります。

まさに、コロナ禍の現状を踏まえたアップデートですね。これらは、年末までに実装予定となっています。

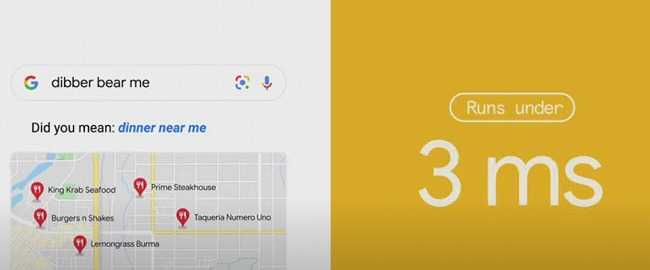

検索時のスペルミスはもう関係ない!

日本語で検索をする際にはあまり必要ないかもしれませんが、英単語を入力する際、スペルミスをしてしまい思うような検索結果が表示されないという経験は、多くの人にあるかと思います。

Google検索では、スペルミスを予測し、正しいと予測される結果を表示する機能がありますが、これがさらに正確で早くなります。

これは、新しいスペルアルゴリズムによるもので、6億8000万のパラメーターを持つディープニューラルネットを使用するとのこと。これにより、スペルミスのエッジケースをモデル化し、正しい答えに導いてくれます。

このスペルミスの確認、修正は3ミリ秒で行われます。使用していて体感できる時間ではなく、ほぼ瞬時に情報を修正してくれるといっても過言ではないでしょう。

AI技術でより適切な回答が得られる?

Googleで検索をする場合、目当てのページがあるわけではなく、漠然とした検索しかできないことも多いと思います。そのような場合でも、AI技術を用いて、ユーザーが探している検索結果を表示、また、そのページの不必要な部分は省略して表示できるようになります。

また、探している答えが様々な動画コンテンツの中で紹介されている場合、その動画を表示するだけでなく、動画内の必要なポイントから再生してくれるようになります。1つの情報を得るために、長い動画を確認する必要がなくなるというわけです。

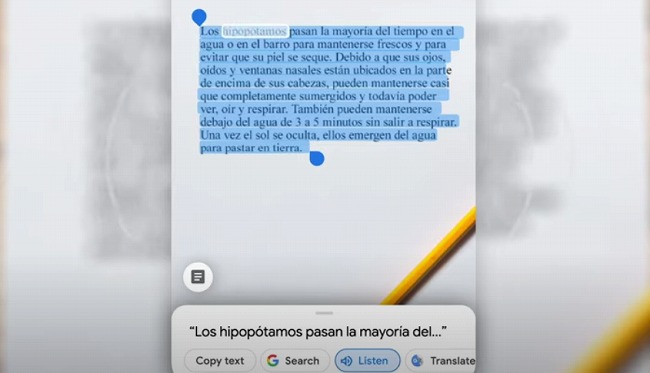

Google レンズは音声での翻訳にも対応

Google レンズとは、撮影した写真に写っているものの情報を提示してくれるアプリで、例えば道端の花を撮影すると、その花がなんという種類のものなのかを教えてくれます。教科書や本を撮影すれば、翻訳機能を使用することは、現時点でも可能です。

この翻訳機能がさらに進化し、翻訳した内容を音声として読み上げてくれるようになります。言語学習はより快適になるのではないでしょうか。

また、同じくGoogle レンズを使用すれば、数学や化学などの問題を解く手助けもしてくれます。途中式も表示してくれるので、どのようなプロセスで問題を解いていくのかを確認できます。子供に宿題の解き方を聞かれた際、採点をする際に役立つでしょう。

販売者と消費者の両方を助けるサービス!?

Google上での買い物についても、より快適に行えるようにアップデートが施されています。先日、Googleは販売者が無料で商品を掲載できるようにしました。これにより、様々な製品が多くの消費者の目に留まるようになったのは、販売者も消費者もありがたいですね。

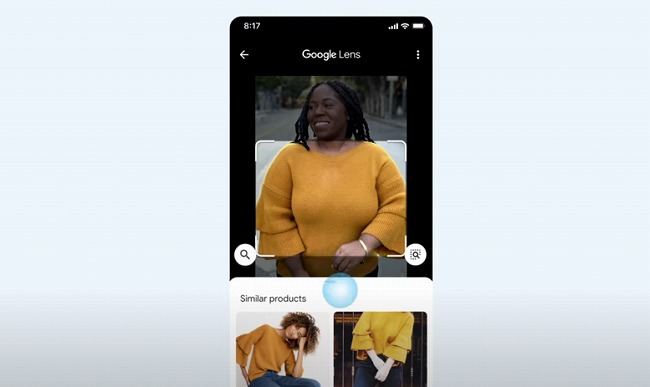

また、ネットを見ている際、たまたま目に入った画像に写っている服を購入したいと思ったら、その画像のを長押しすることで、似ている製品を表示してくれるようになります。色だけでなく、サイズ感や素材まで確認し、より探しているものに近い製品を紹介できるようになります。

AR技術を使い、目の前にある製品が実際に家や街中で使用するとどのように見えるのかを表示することもできるようになります。車を購入する際は、その車が街を走っている様子を確認できる、という具合です。こちらは数か月後に実装予定とのことです。

取材・文/佐藤文彦

DIME MAGAZINE

DIME MAGAZINE